田間表型機器人作為大田作物表型數據采集的關鍵平臺,實現其在作物全生育期無人化采集,亟需適配大田復雜環境的高效導航方法。

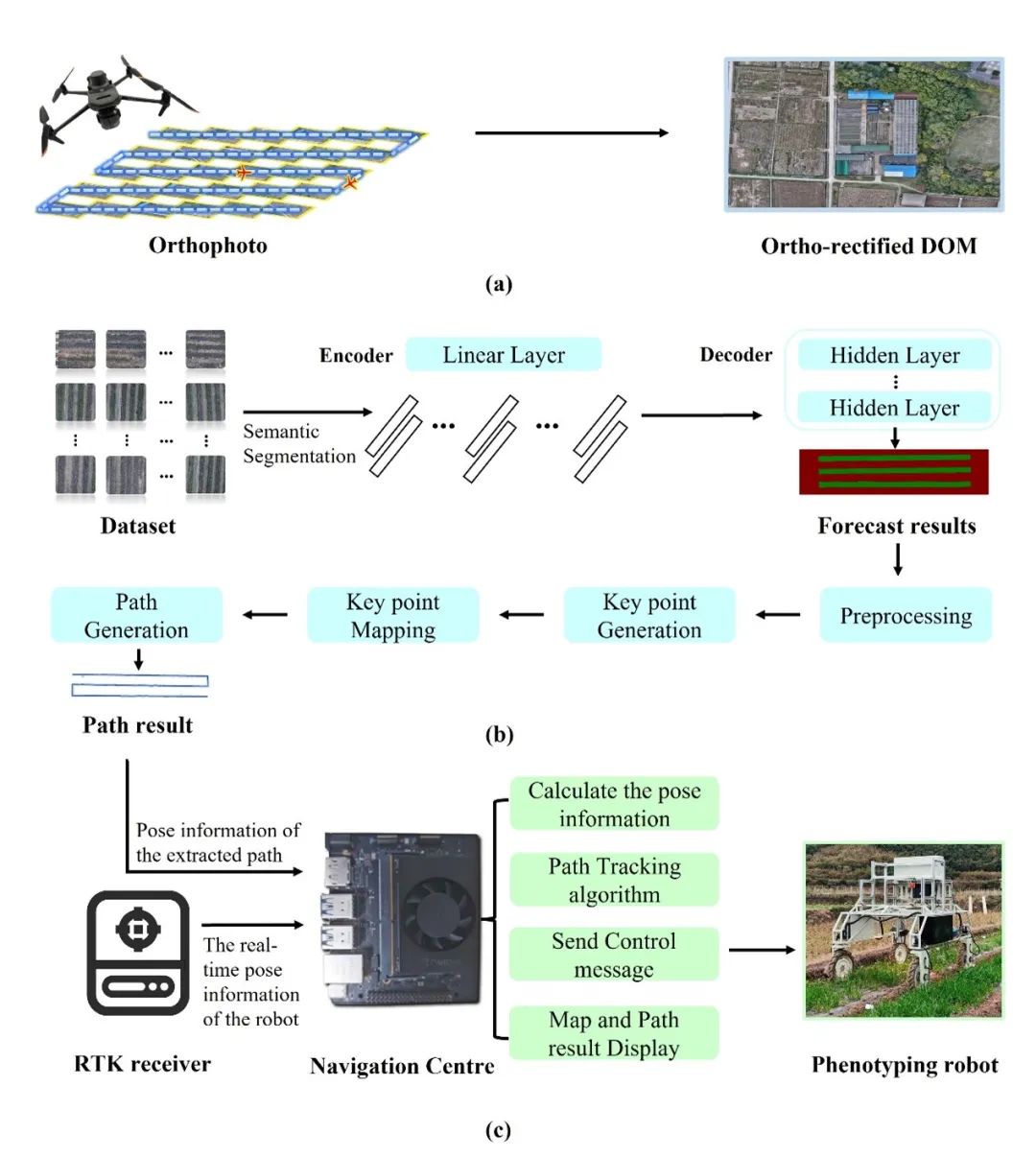

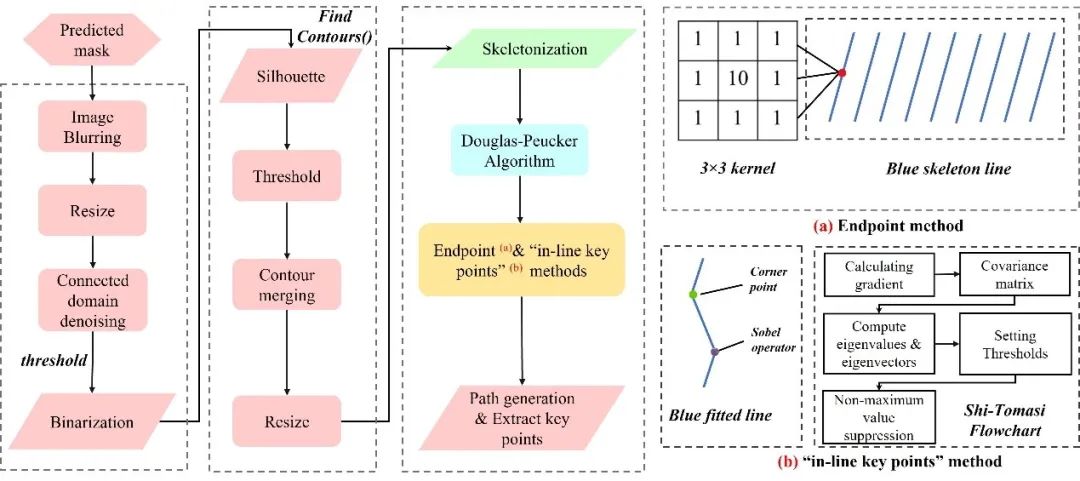

該導航方法通過配備實時動態差分(RTK)模塊的無人機構建高精度田塊地圖,運用SegFormor-B0語義分割模型精準檢測作物行,提取關鍵坐標點以生成表型機器人的導航路徑。同時,團隊提出基于純追蹤算法的自適應控制器,能依據機器人當前位置與目標位置間的距離、角度偏差和橫向偏差,動態調整轉向角度。

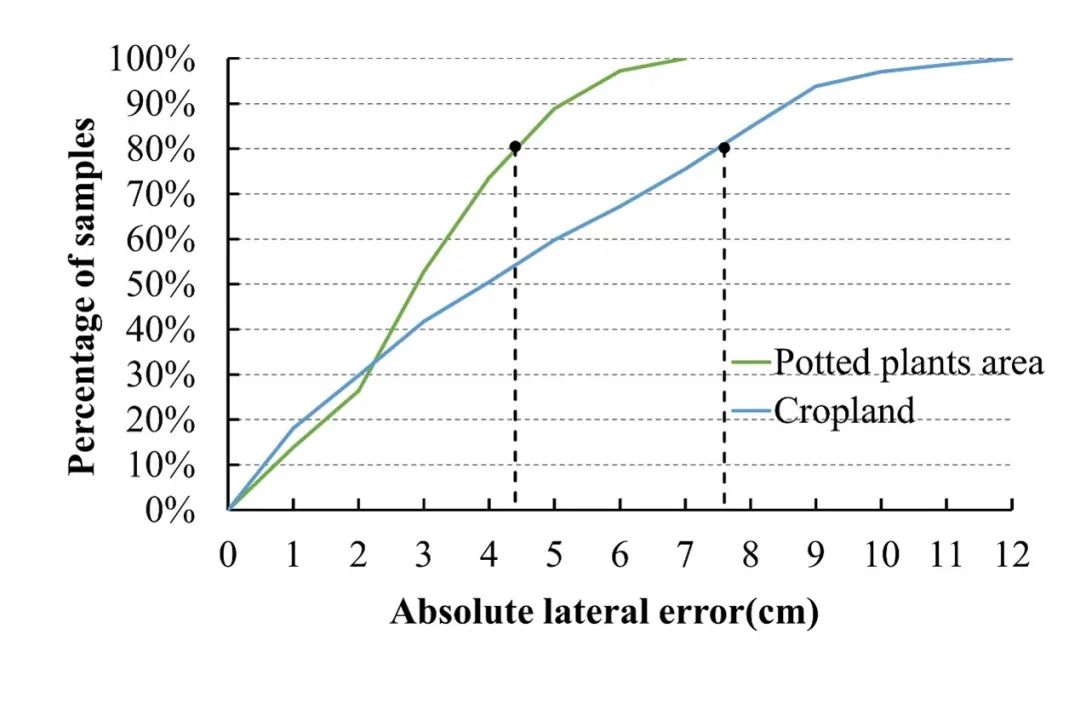

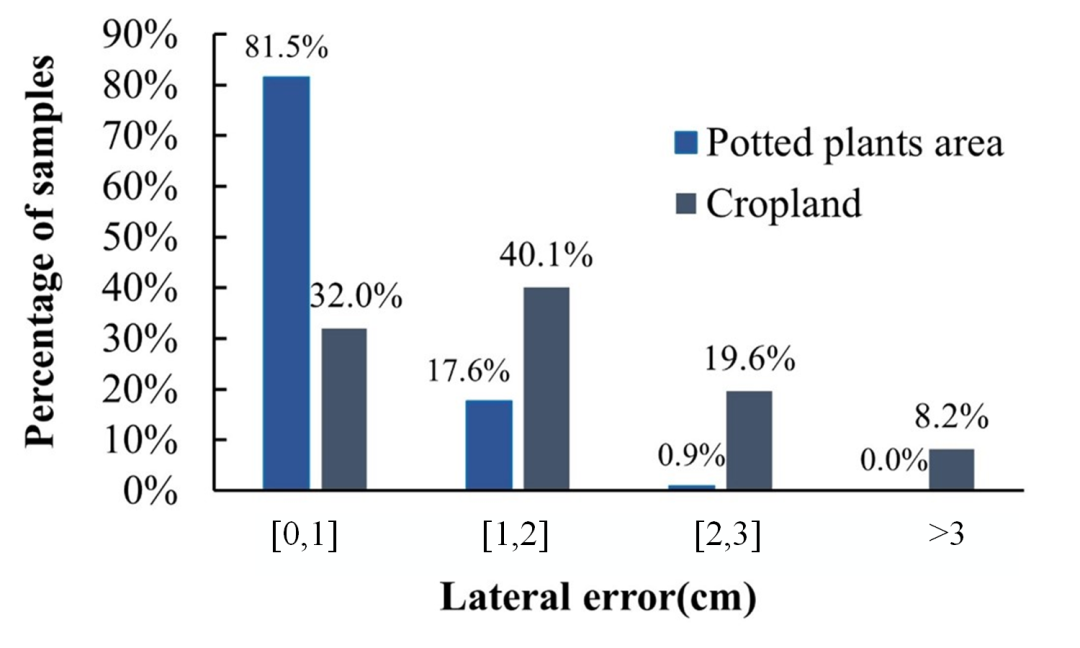

在團隊自主研發的表型機器人上,針對盆栽及田間種植作物開展實驗。結果顯示,該方法在提取盆栽植物區行中心線的平均絕對誤差(MAE)為2.83厘米,農田區為4.51厘米。在盆栽植物區,99.1%的全局路徑跟蹤誤差處于2厘米范圍內,平均絕對誤差達0.62厘米,最大誤差為2.59厘米;農田區72.4%的誤差在2厘米范圍內,平均絕對誤差為1.51厘米,最大誤差為4.22厘米。相較于傳統基于全球導航衛星系統(GNSS)的導航方法和單視覺方法,該方法在應對作物動態生長與復雜田間環境時優勢顯著。

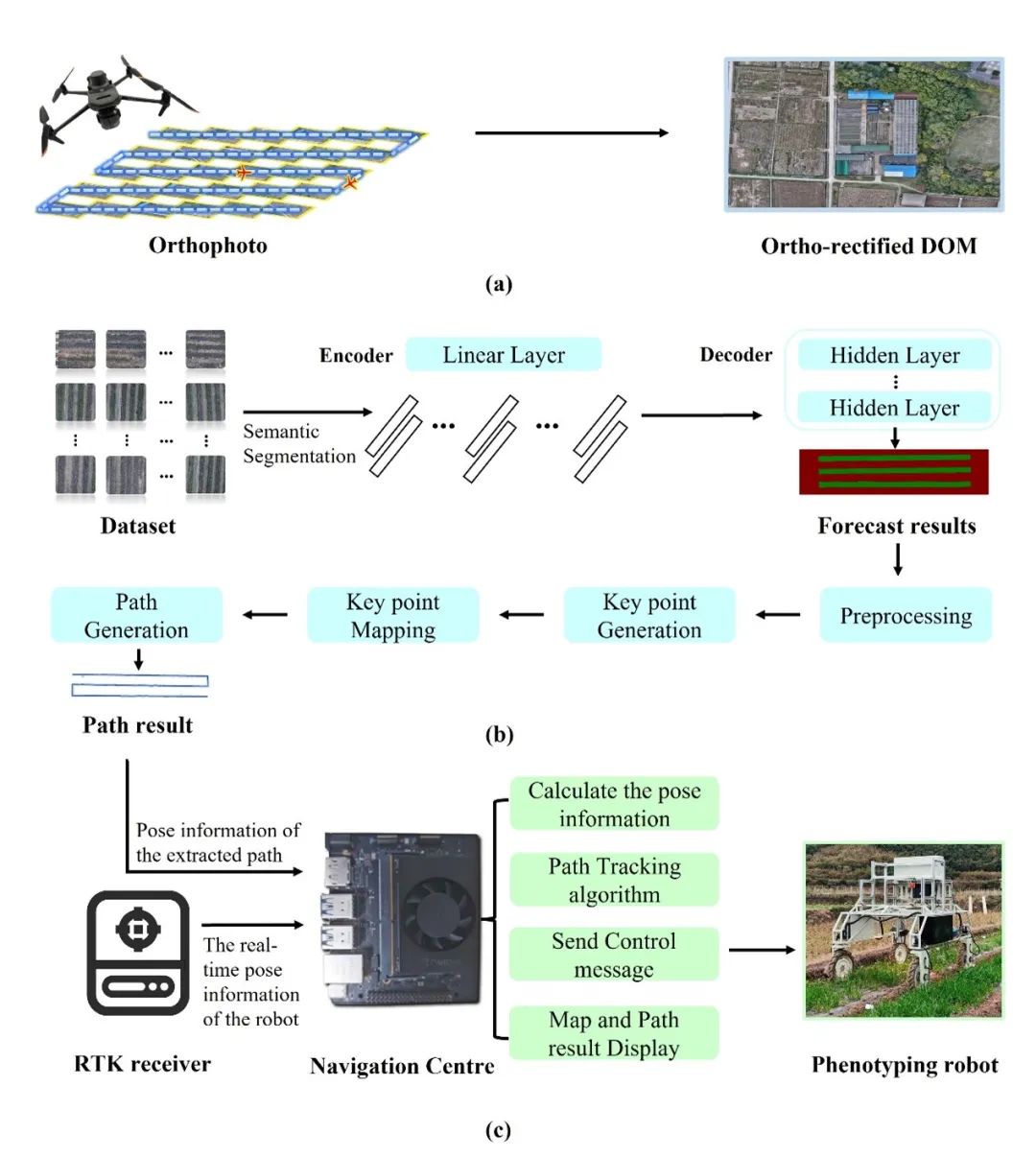

圖1 技術路線

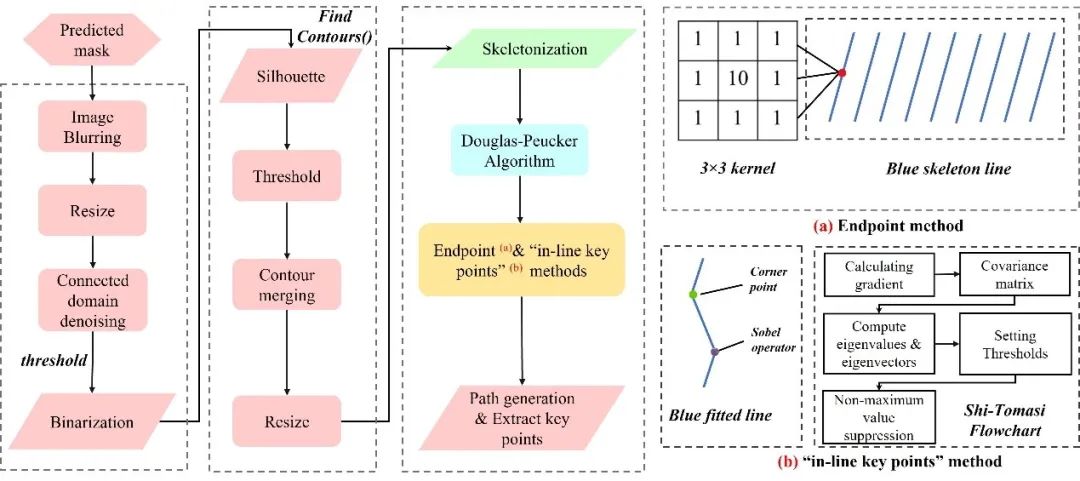

圖2 關鍵坐標點的工作流程圖

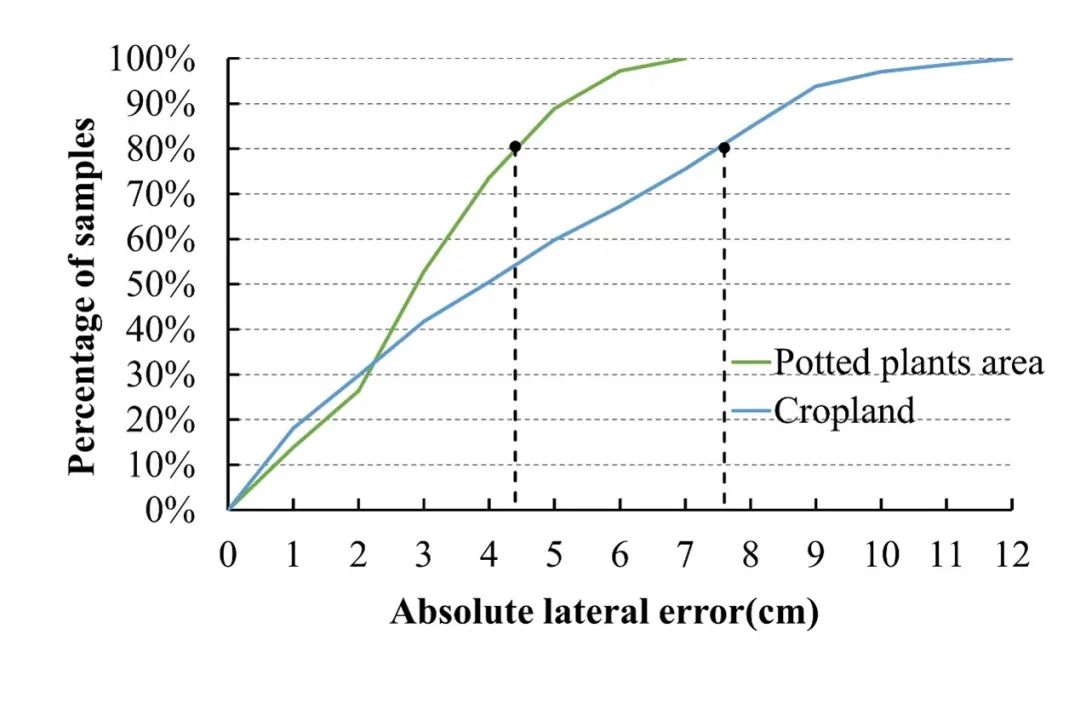

圖3 盆栽作物區和田間作物區兩個場景的路徑提取率結果圖

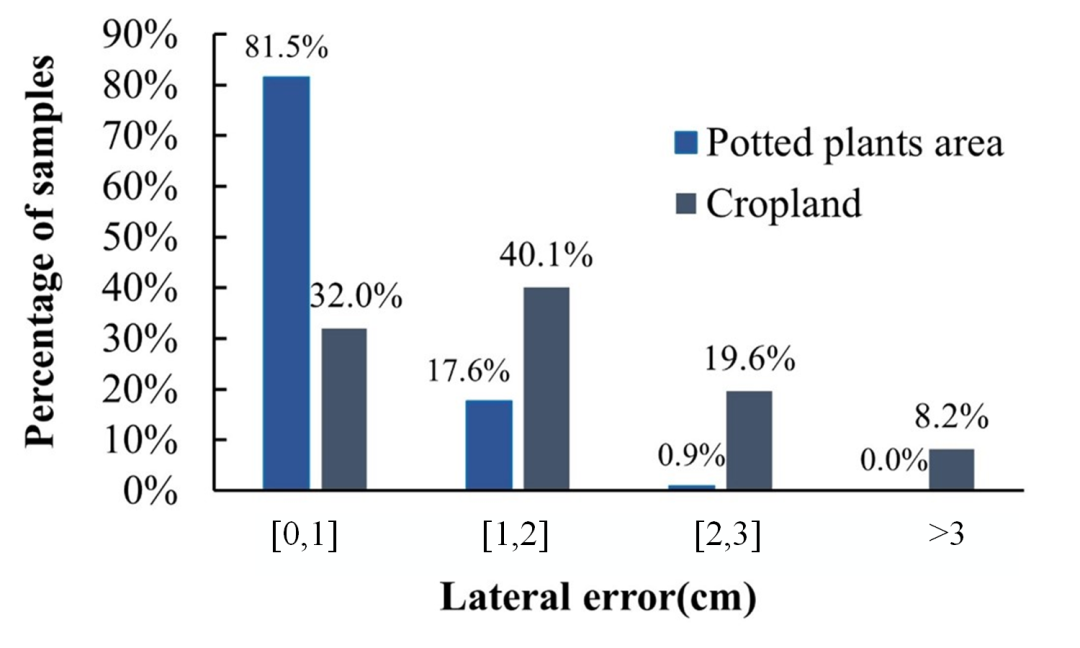

圖4 盆栽作物區和田間作物區兩個場景跟蹤誤差直方圖

此創新方法借助無人機與地面機器人協同,構建起“全局感知 - 局部執行”的閉環優化系統,成功突破傳統導航技術依賴靜態環境的局限,大幅提升表型機器人在農田環境中的導航精度與環境適應性。

華中農業大學作物表型團隊聚焦作物表型組高通量獲取、智能精準解析及作物育種應用等交叉研究領域。團隊研究生張子康和李正達為論文共同第一作者,宋鵬副教授為通訊作者。本研究獲得國家重點研發計劃、國家自然科學基金、湖北省農業核心攻關項目的支持。

文章鏈接:https://doi.org/10.1016/j.aiia.2025.05.005